自从大型语言模型(LLM)和先进的聊天模型发布以来,人们已经使用了各种技术来优化这些人工智能系统的输出,使其更适配本地化的数据和应用场景。其中 检索增强生成(RAG)和微调(Fine-tuning)是提升大语言模型性能的两种常用方法,除此之外还有提示工程,但是提示工程本身是调整的输入给大模型的信息,而不是对大模型的调整。

主要方式

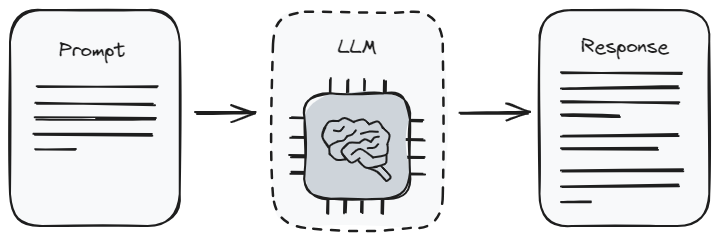

提示工程

提示是与任何大型语言模型进行交互的最基本方式。这就像给出指示。当您使用提示时,您告诉模型您希望它给您提供什么样的信息。这也被称为提示工程。这有点像学习如何提出正确的问题以获得最佳答案。但是它有一定的局限性。这是因为模型只能返回它在训练中已经了解的内容。

提示工程的好处在于它非常直观。您不需要成为技术专家才能做到这一点,这对大多数人来说非常好。但是,由于它在很大程度上依赖于模型的原始学习,它可能无法始终提供您所需的最新或最具体的信息。在处理一般主题或仅需要快速答案而不涉及太多细节时,这是最好的选择。

- 优点:

易于使用:提示工程用户友好,不需要高级技术技能,适用于广泛的用户群体。

成本效益:由于使用预训练模型,与微调相比,计算成本较低。

灵活性:可以快速调整提示以探索不同的输出,无需重新训练模型。 - 缺点:

不一致性:模型的响应质量和相关性可能会根据提示的措辞而有很大差异。

定制能力有限:定制模型的响应能力受限于创造有效提示的创造力和技巧。

依赖模型的知识:输出仅限于模型在初始训练过程中学到的内容,对于高度专业化或最新信息,效果较差。

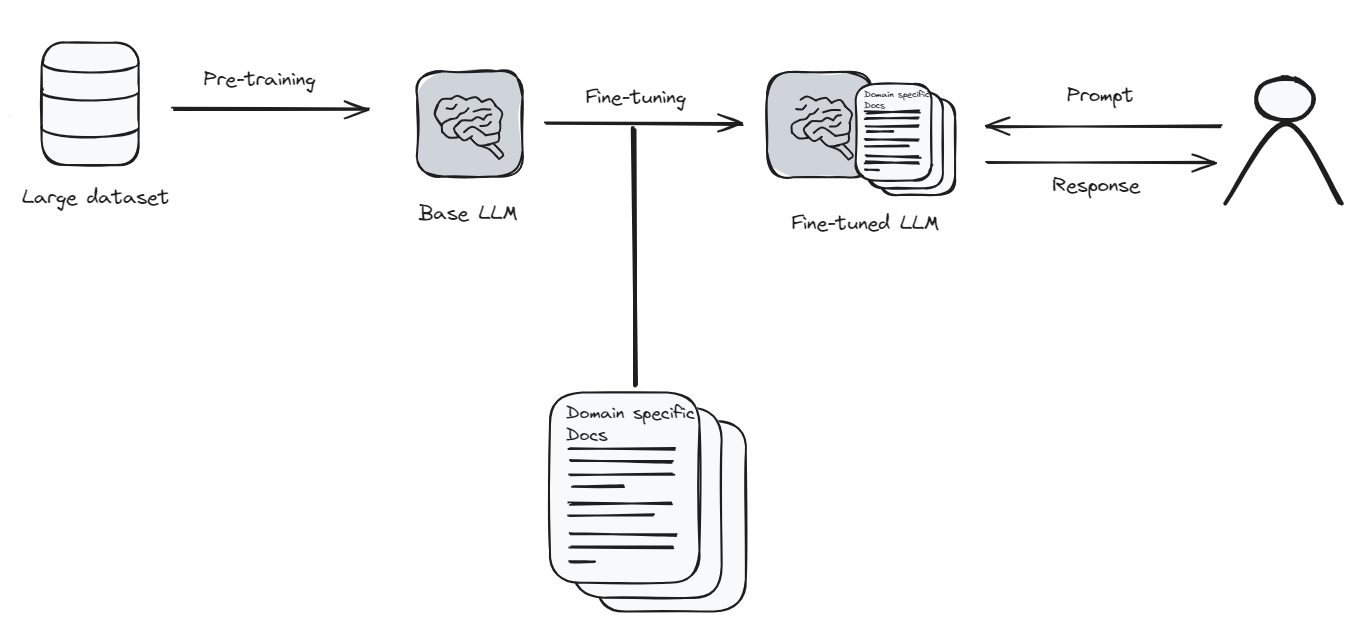

微调

微调是指对语言模型进行更新和特殊训练。可以将其视为更新手机上的应用程序以获得更好的功能。但在这种情况下,应用程序(模型)需要大量的新信息和时间来正确学习所有内容。这有点像模型回到学校。

由于微调需要大量的计算资源和时间,因此可能会很昂贵。但是,如果您需要语言模型非常了解特定主题,那么微调是值得的。这就像教模型成为您感兴趣的领域的专家。在微调之后,模型可以给出更准确、更接近您寻找的答案。

- 优点:

定制能力:允许进行广泛的定制,使模型能够生成针对特定领域或风格的响应。

提高准确性:通过在专门的数据集上进行训练,模型可以生成更准确和相关的响应。

适应性:微调的模型可以更好地处理特定领域或原始训练中未涵盖的最新信息。 - 缺点:

成本:微调需要大量的计算资源,比提示更昂贵。

技术技能:这种方法需要对机器学习和语言模型架构有更深入的了解。

数据要求:有效的微调需要大量且精心策划的数据集,这可能很具有挑战性。

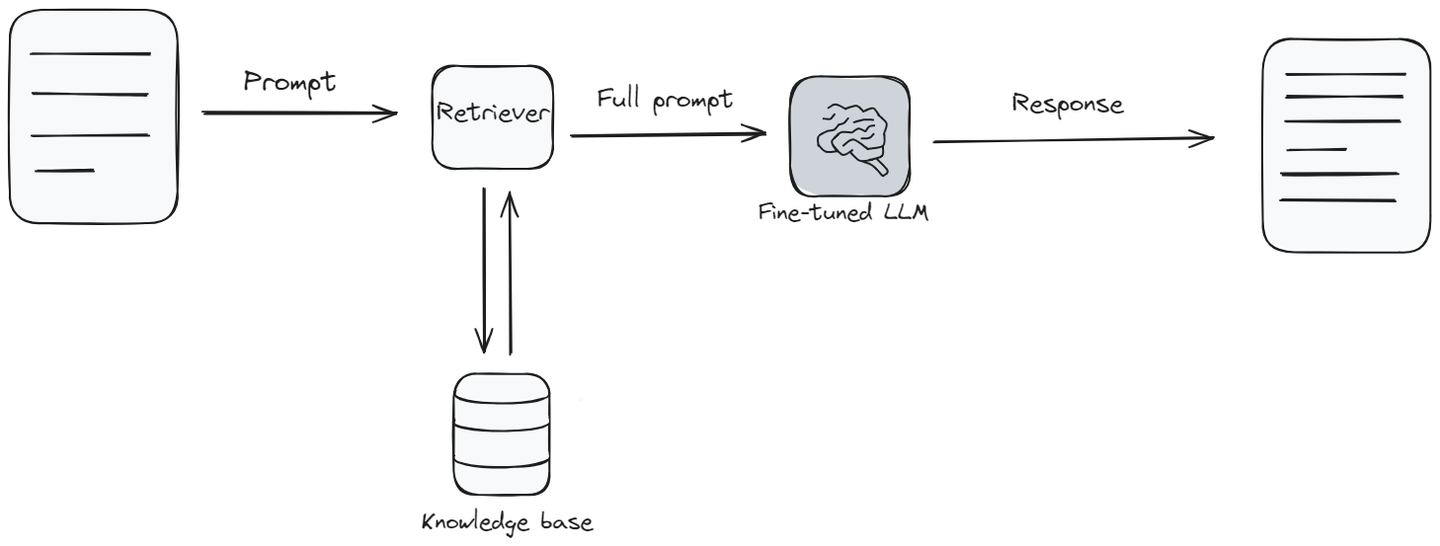

检索增强生成(RAG)

检索增强生成(RAG)将传统语言模型的能力与外部知识库的精确性相结合。当模型需要回答问题时,它首先从知识库中查找并收集相关信息,然后根据该信息(整合进模型的输入信息中)回答问题。这就像模型快速检查信息库以确保给出最佳答案。

RAG在需要最新信息或涉及比模型最初学习的主题范围更广的答案时特别有用。在设置和成本方面,它介于两者之间。它非常好,因为它帮助语言模型给出新鲜且更详细的答案。但是,与微调一样,它需要额外的工具和信息才能发挥良好的效果。RAG系统的成本、速度和响应质量严重依赖于向量数据库,这使其成为RAG系统的非常重要的一部分。

- 优点:

动态信息:通过实时检索外部数据,确保提供的信息是最新和相关的。这对于需要最新信息的应用非常重要,例如新闻相关查询或快速发展的领域。

平衡:在定制和资源需求方面也提供了一个平衡的方法。与完全微调相比,它不需要大量的计算资源,可以进行更灵活和资源高效的操作,使更多的用户和开发人员能够使用。

上下文相关性:通过额外的上下文增强模型的响应,从而产生更具见解和细致的输出。 - 缺点:

复杂性:实施RAG可能很复杂,需要在语言模型和检索系统之间进行集成。

资源密集型:虽然比完全微调要求的资源少,但RAG仍需要相当大的计算能力。

数据依赖性:输出的质量严重依赖于检索到的信息的相关性和准确性。